Levanto la mano frente a la cámara. El dedo índice apunta. Y entonces, la banda transportadora virtual comienza a moverse. Parece magia. Pero no lo es.

Ese gesto –tan simple, tan humano– es el resultado de semanas de pruebas, errores y ajustes. De líneas de código que no responden, de modelos que no entienden, de señales que no llegan. Lo que hoy parece fluido, antes fue una secuencia caótica de fallos intermitentes y frustraciones técnicas.

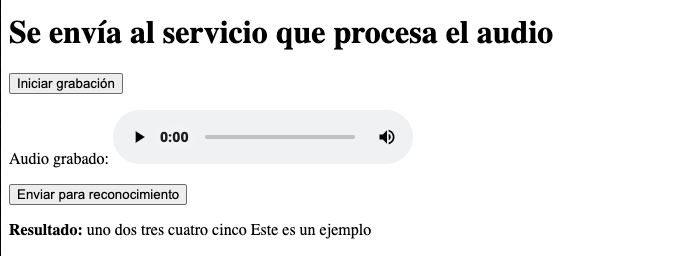

La idea era clara desde el inicio: construir un puente entre lo humano y lo automatizado. Que un gesto pudiera activar una máquina. Que la intención bastara para que algo se moviera, sin botones, sin contacto físico, solo con una señal emitida por el cuerpo.

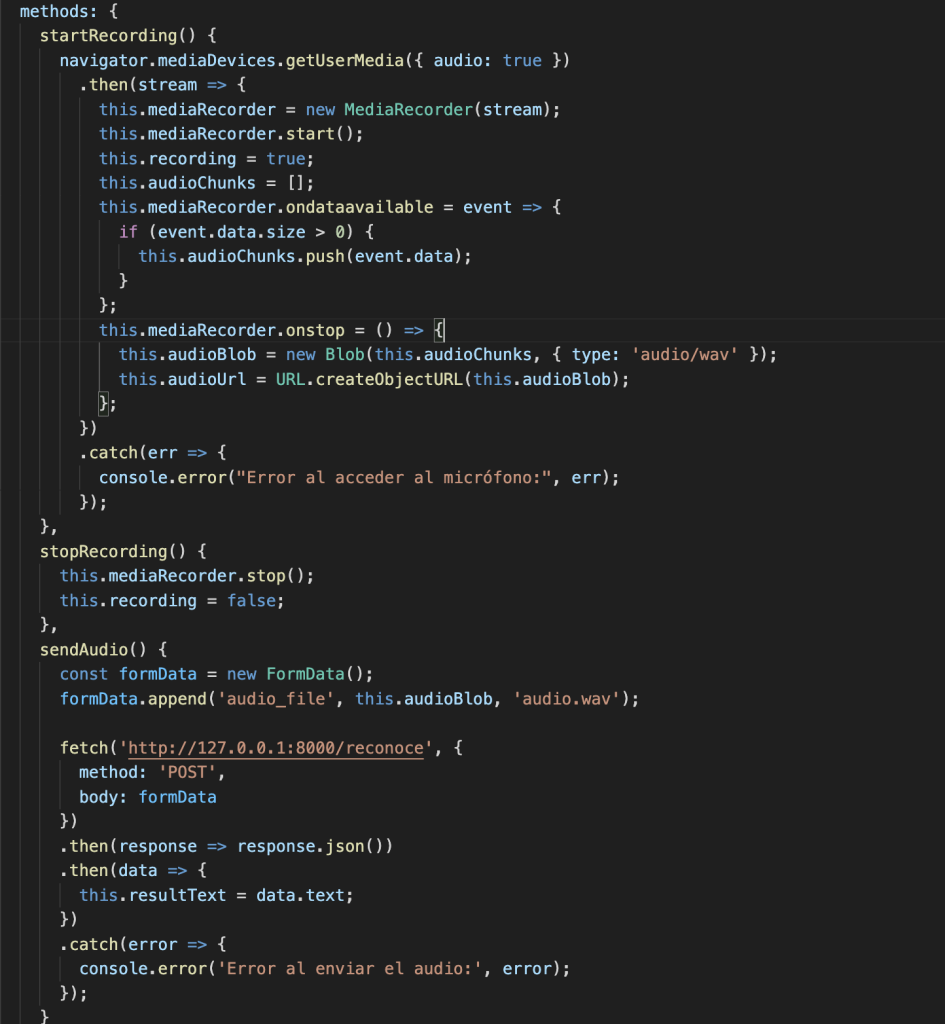

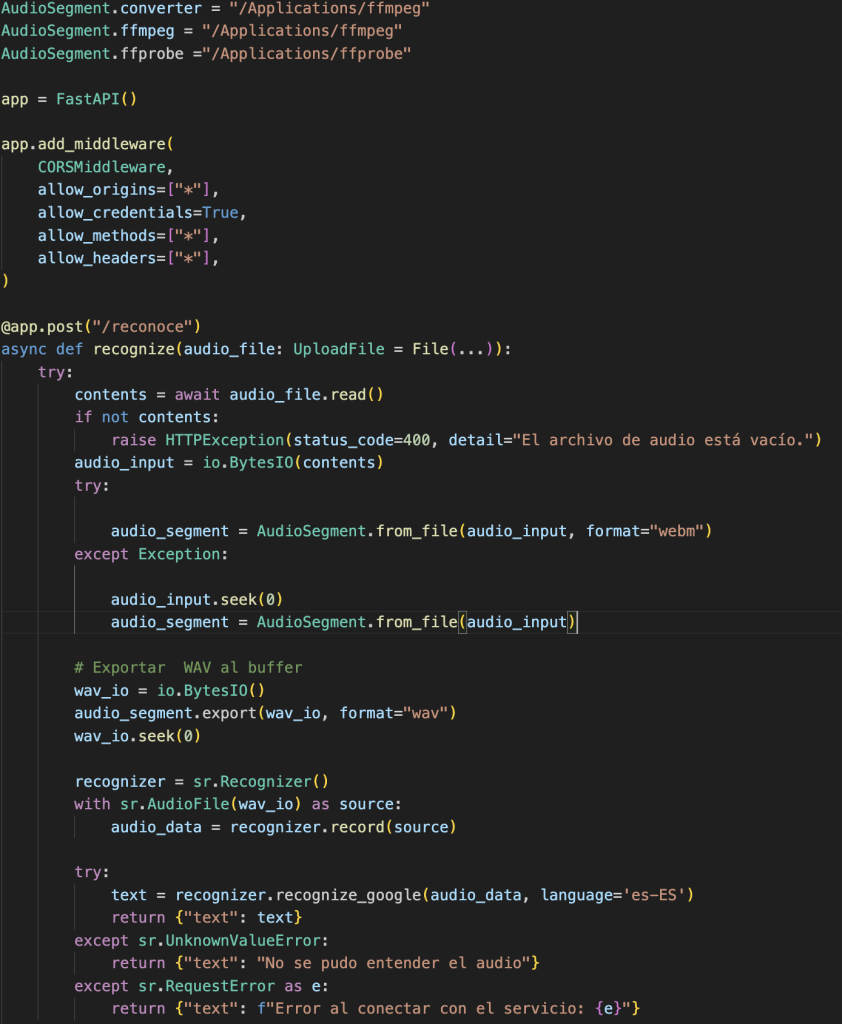

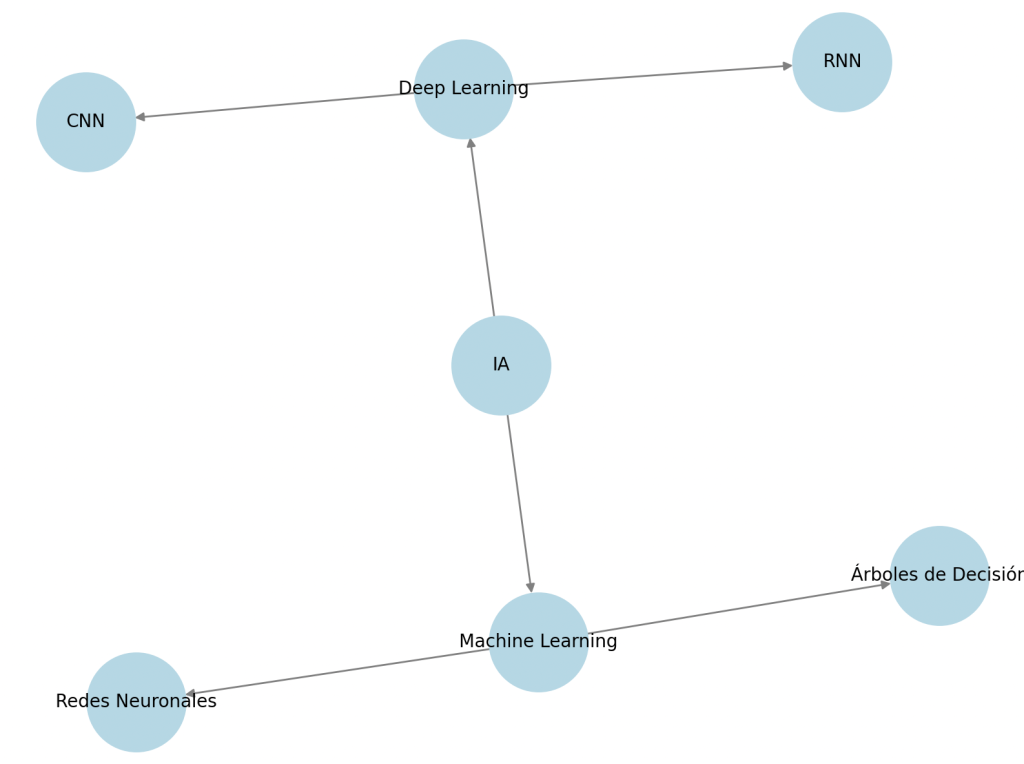

Lo que desarrollé fue una arquitectura distribuida:

- Python con visión artificial usando MediaPipe detecta los gestos.

- Unity simula la banda transportadora y los sensores.

- Una ESP32 recibe comandos por red para activar indicadores físicos y lo envía a un PLC

En el papel, todo estaba claro. En la práctica, fue otra historia.

Los gestos no se reconocían.

Los sockets se caían.

La ESP o python no recibía.

Unity se congelaba.

Y yo… repetía la prueba.

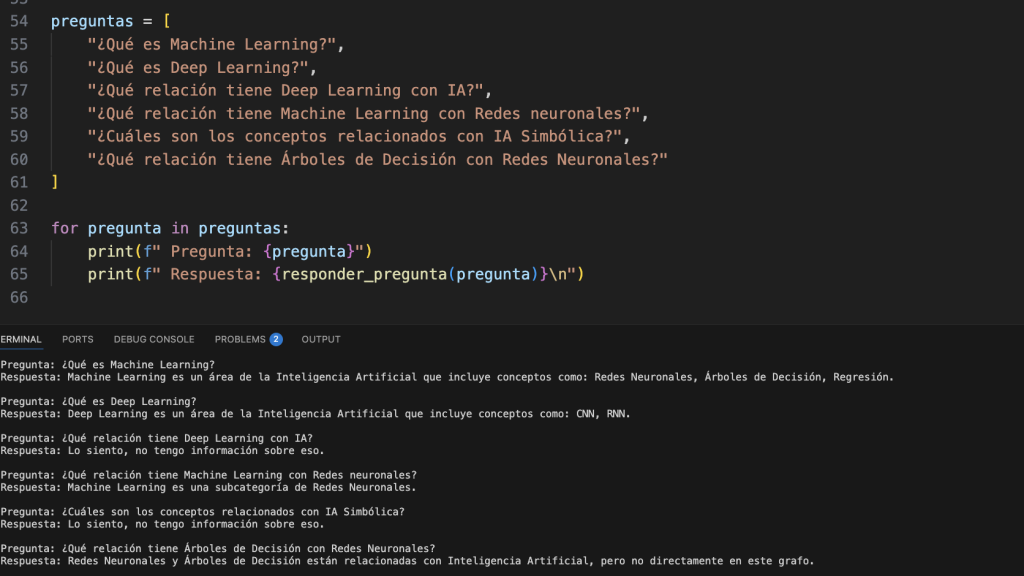

Una y otra vez. Cambié el código, ajusté retardos, probé diferentes protocolos, capturé logs. Las preguntas se acumulaban:

- ¿Dónde está el cuello de botella?

- ¿Qué tan rápido es lo “rápido suficiente”?

- ¿Cómo evito una activación falsa sin perder sensibilidad?

- ¿Puede coexistir el control visual con botones físicos?

- ¿Qué significa que el sistema “entienda” mi gesto?

Fueron muchas horas de repetición obsesiva. Días enteros donde solo conseguía que el sistema hiciera “casi lo que debía”. Pero en medio de cada error, se afianzaba una idea: lo real no empieza cuando todo funciona, sino cuando algo cobra sentido.

Hoy puedo decir que el sistema responde. Que un gesto puede iniciar el flujo. Que el cuerpo puede ser interfaz. No porque sea perfecto, sino porque se adaptó. Y porque yo también me adapté a él.

Cuando el gesto se vuelve comando, la máquina obedece. Pero más importante aún: la tecnología se convierte en extensión de la intención humana.

Y ahí, justo ahí, es donde para mí empieza lo real.

Me queda claro a partir de todos mis errores hacía donde puedo ir y como siempre me quedo con todo lo aprendido :).